Phần lớn người dùng AI không kiểm tra output. Đọc xong, thấy nghe hợp lý, dùng luôn. Đó là trust mù.

Hai bài trước đã giải thích vì sao đó là vấn đề. AI bịa rất tự tin (hallucination). AI thiên lệch mà không cảnh báo (bias). Output sai trông y hệt output đúng.

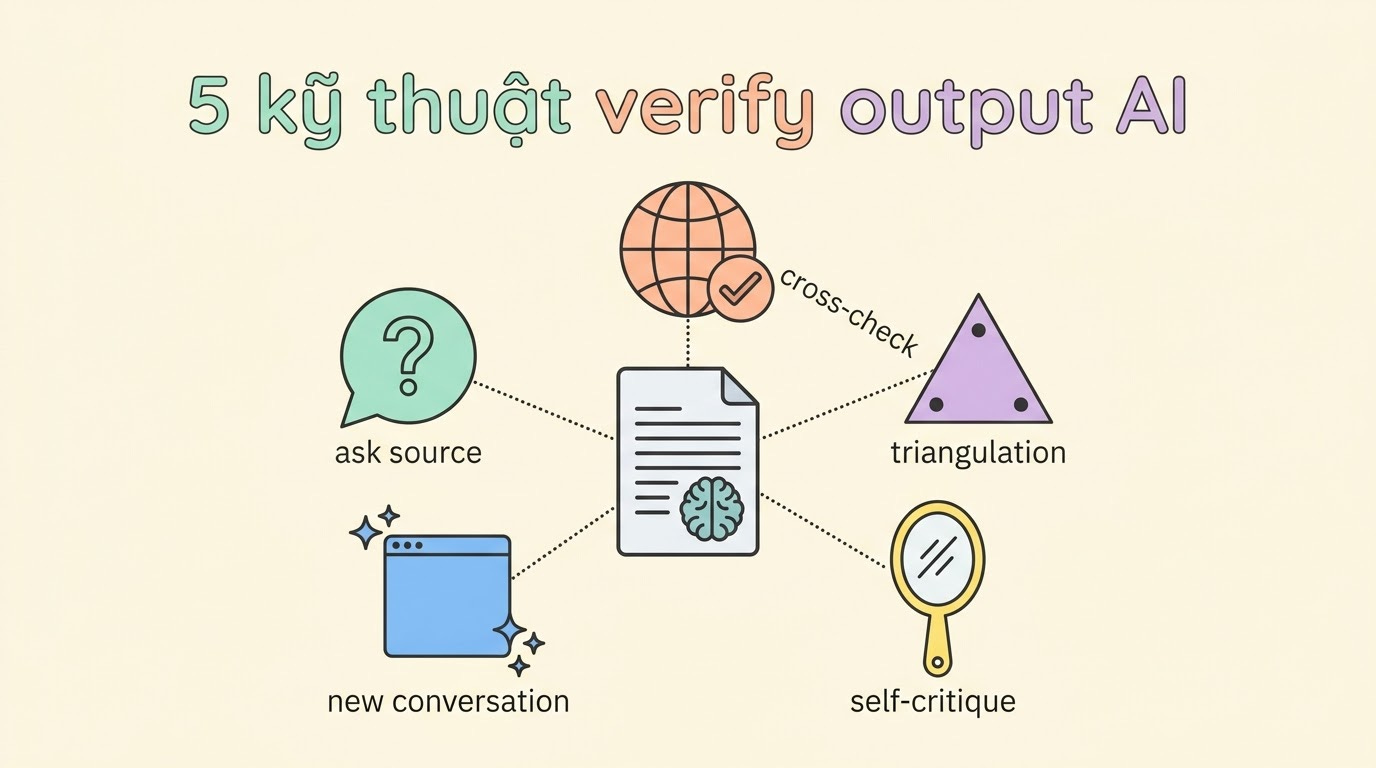

Vậy kiểm tra bằng cách nào? 5 kỹ thuật dưới đây sắp từ nhanh đến kỹ. Kỹ thuật 1 mất 30 giây. Kỹ thuật 5 mất 5 phút. Không cần dùng hết cả 5. Nhưng mọi thứ quan trọng nên qua ít nhất 2 kỹ thuật.

KT1: Hỏi "nguồn nào?"

Đơn giản nhất. Mất 30 giây.

AI đưa ra một con số, một trích dẫn, một nhận định. Bạn hỏi ngay: "Thông tin này từ nguồn nào?"

Nếu AI trả lời rõ ràng: tên tài liệu, năm, tác giả, bạn có thứ để kiểm tra tiếp (xem KT2). Nếu AI trả lời mơ hồ kiểu "theo nhiều nghiên cứu" hoặc "đây là kiến thức phổ biến", đó là dấu hiệu đỏ.

Cảnh báo quan trọng: AI có thể bịa nguồn. Bài 15 đã nói chuyện này. Hỏi nguồn không phải để tin nguồn đó. Mà để có thứ mang đi kiểm tra bằng cách khác.

Ví dụ: bạn nhờ AI viết đoạn về thị trường bất động sản. AI nói "Theo Savills Q3 2025..." Bạn hỏi nguồn. AI đưa tên báo cáo cụ thể. Bước tiếp: vào website Savills kiểm tra báo cáo đó có thật không (xem KT2).

Đừng dừng ở đây. Kỹ thuật này là bước sàng lọc đầu tiên, không phải bước cuối.

KT2: Cross-check bằng nguồn gốc

Hiệu quả nhất cho facts, số liệu, trích dẫn.

AI nói: "Theo McKinsey 2024, 72% doanh nghiệp đã áp dụng AI." Bạn mở Google, gõ đúng cụm đó. Tìm đến báo cáo McKinsey gốc. So sánh.

Có 3 kết quả:

1. Khớp hoàn toàn. Tốt. Dùng được.

2. Gần đúng nhưng lệch. AI nói 72%, báo cáo gốc nói 65%. Hoặc đúng số nhưng sai năm. Đây là hallucination nhẹ, sửa được.

3. Không tìm thấy. Báo cáo không tồn tại. Hoặc tồn tại nhưng nội dung khác hẳn. Bỏ. Không dùng.

Kỹ thuật này mất 2-3 phút. Nhưng đây là cách đáng tin nhất. Vì bạn đang so sánh với nguồn gốc, không phải so sánh AI với AI.

Mẹo: Google chính xác cụm từ bằng dấu ngoặc kép. "72% doanh nghiệp áp dụng AI" McKinsey 2024. Kết quả chính xác hơn nhiều so với tìm mơ hồ.

Thêm một mẹo: ưu tiên website chính thức (mckinsey.com, who.int, gso.gov.vn) thay vì blog tổng hợp. Blog tổng hợp có khi cũng lấy từ AI.

KT3: Hỏi ngược (triangulation)

Kỹ thuật này kiểm tra tính nhất quán.

Thay vì hỏi lại cùng câu, bạn hỏi câu khác về cùng chủ đề. Nếu AI hiểu đúng vấn đề, hai câu trả lời sẽ ăn khớp. Nếu nó bịa, hai câu trả lời sẽ mâu thuẫn.

Ví dụ: AI nói "Doanh thu ngành SaaS Đông Nam Á năm 2024 là 15 tỷ đô."

Thay vì hỏi "Có chắc không?", bạn hỏi: "Tốc độ tăng trưởng ngành SaaS Đông Nam Á giai đoạn 2020-2024 là bao nhiêu?"

Nếu AI nói tăng trưởng 25%/năm và năm 2020 là 5 tỷ đô, bạn tính nhanh: 5 tỷ x 1.25^4 = khoảng 12 tỷ. Lệch với con số 15 tỷ. Có gì đó không khớp.

Triangulation buộc AI phải nhất quán qua nhiều góc. Bịa một con số thì dễ. Bịa một hệ thống con số ăn khớp với nhau thì khó hơn nhiều.

Kỹ thuật này đặc biệt hay cho phân tích. Bạn không cần là chuyên gia. Chỉ cần hỏi cùng chủ đề từ 2-3 góc khác nhau, rồi xem các mảnh ghép có khớp không.

KT4: Tự phản biện

Bạn yêu cầu AI kiểm tra chính nó.

Cách làm: sau khi nhận output, gõ "Hãy chỉ ra những điểm có thể sai trong câu trả lời vừa rồi."

AI sẽ liệt kê những chỗ yếu. Đôi khi nó phát hiện ra lỗi thật. Đôi khi nó chỉ ra giới hạn bạn chưa nghĩ tới.

Nhưng cẩn thận. Kỹ thuật này có nhược điểm lớn. AI đôi khi "nhận lỗi" dù câu trả lời ban đầu đúng. Bạn hỏi "có gì sai?", nó tìm cái sai cho bạn, dù phải bịa ra cái sai.

Giống hỏi nhân viên "Cái này có lỗi gì không?" Nhiều người sẽ tìm ra "lỗi" để trả lời, dù thật ra không có lỗi nào.

Vì vậy, dùng KT4 để mở rộng góc nhìn, không phải để kết luận. AI nói "phần X có thể sai" thì bạn kiểm tra phần X bằng KT2. Không phải tự động bỏ phần X.

KT5: Mở conversation mới

Kỹ thuật chống confirmation bias.

Trong cùng một cuộc trò chuyện, AI có xu hướng giữ nhất quán với những gì nó đã nói. Nó "cam kết" với câu trả lời trước. Hỏi lại cùng câu, nó lặp lại cùng đáp án, dù sai.

Cách phá: mở hoàn toàn conversation mới. Hỏi cùng câu hỏi. So sánh hai kết quả.

Nếu hai conversation cho cùng đáp án, khả năng đúng cao hơn. Nếu hai conversation cho đáp án khác nhau, có vấn đề. Đừng chọn cái nào nghe hay hơn. Kiểm tra bằng KT2.

Tại sao cần conversation mới? Vì trong bài 4 (context window), bạn đã biết AI đọc lại toàn bộ cuộc trò chuyện mỗi lần trả lời. Nó "thấy" câu trả lời trước, nên bị neo vào đó. Conversation mới = trang giấy trắng, không bị ảnh hưởng.

Mẹo nâng cao: dùng 2 AI khác nhau. ChatGPT và Claude. Hoặc Gemini và ChatGPT. Hai model khác nhau bịa giống nhau thì hiếm. Hai model cho cùng đáp án thì đáng tin hơn.

Khi nào dùng kỹ thuật nào?

Không phải lúc nào cũng cần cả 5.

| Tình huống | Kỹ thuật nên dùng |

|---|---|

| Email nội bộ, nháp ý tưởng | KT1 là đủ. Hoặc không cần. |

| Báo cáo có số liệu | KT1 + KT2. Bắt buộc. |

| Nội dung publish công khai | KT2 + KT3. Thêm KT5 nếu quan trọng. |

| Quyết định lớn (pháp lý, tài chính) | KT2 + KT3 + KT5. Dùng nhiều nguồn. |

| Nghiên cứu, phân tích sâu | Cả 5. Không bỏ bước nào. |

Quy tắc ngón tay cái: hậu quả càng lớn, verify càng kỹ. Email nội bộ sai tên thì xin lỗi là xong. Hồ sơ pháp lý sai trích dẫn thì mất 5.000 đô và uy tín.

30 giây thay đổi mọi thứ

Quay lại con số: 30 giây hỏi nguồn, 2 phút Google. Đó là khoảng thời gian giữa "dùng AI thông minh" và "tin AI mù quáng".

Bạn không cần nghi ngờ mọi thứ AI nói. Bạn cần thói quen kiểm tra những thứ quan trọng. Giống lái xe: không cần hoang tưởng tai nạn, nhưng cần thắt dây an toàn.

5 kỹ thuật này là dây an toàn của bạn khi dùng AI. Chọn ít nhất 2 cho mọi output quan trọng. Thành thói quen rồi, nó nhanh hơn bạn tưởng.

Và nhớ: verify không phải vì bạn không tin AI. Mà vì bạn tin output của mình phải đúng.

---

📚 Mục lục Series AI Agent

Bài 06. AI làm được gì? Bản đồ tools mà bạn chưa biết mình có

Bài 07. "Mở sách cho AI đọc": tại sao cung cấp context thay đổi mọi thứ

Bài 09. 5 thành phần của prompt hiệu quả (và tại sao chúng hoạt động)

Bài 15. AI bịa rất tự tin: Hallucination là gì và tại sao nó xảy ra

Bài 18. Phân loại Xanh/Vàng/Đỏ: khi nào tin AI, khi nào dừng lại